Ciekawostki

AI, EXO Labs, optymalizacja, Pentium II, retro computing, sztuczna inteligencja, technologia, Windows 98

Klaudia Kostrzewa

4 godziny temu

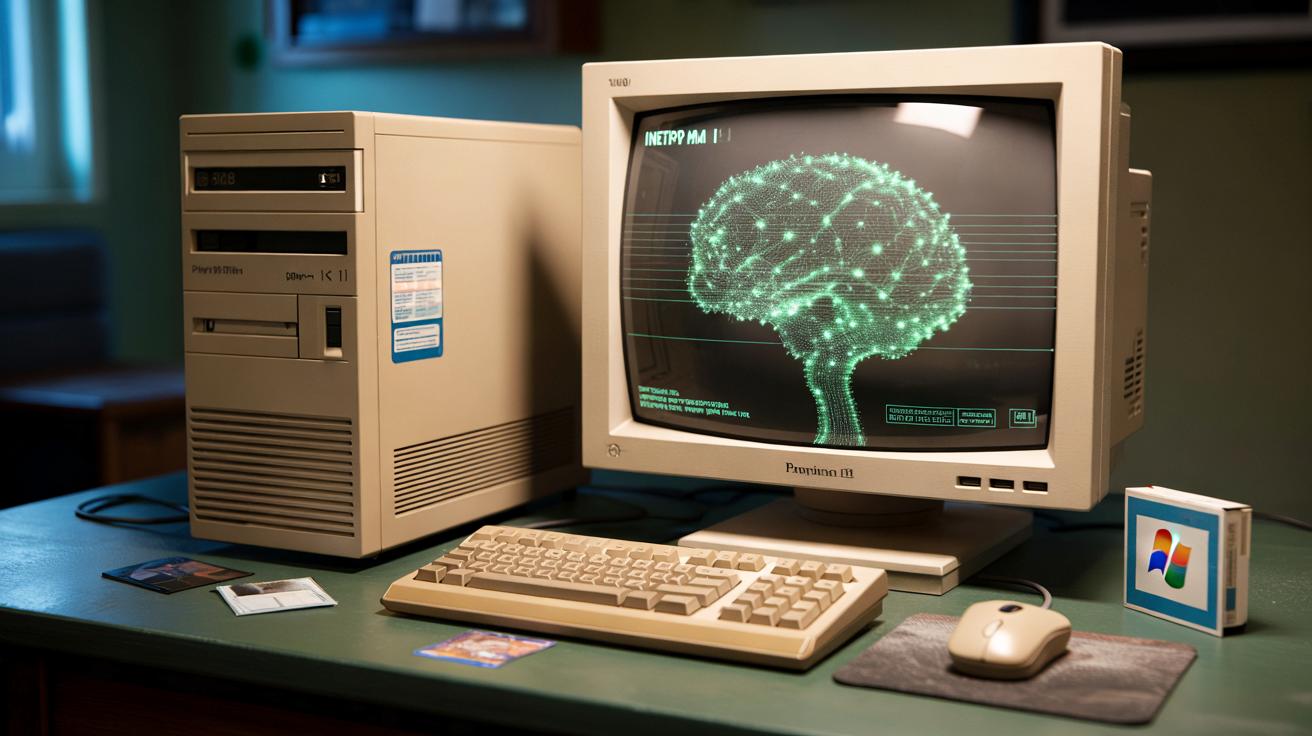

Stary komputer z 1998 roku odpalił AI na zaledwie 128 MB RAM

Ekipa badaczy postanowiła sprawdzić, czy da się uruchomić nowoczesną sztuczną inteligencję na pececie pamiętającym czasy Windows 98.

Najważniejsze informacje:

- Uruchomienie modelu językowego AI na procesorze Pentium II 350 MHz i 128 MB pamięci RAM.

- Wykorzystanie zoptymalizowanego modelu LLama2.c z 260 tysiącami parametrów.

- Osiągnięcie prędkości generowania tekstu na poziomie 39,3 tokena na sekundę.

- Manifest przeciwko konieczności budowy kosztownych i energochłonnych centrów danych dla AI.

- Wykazanie kluczowego znaczenia dopasowania rozmiaru modelu do możliwości sprzętowych.

W erze, w której firmy technologiczne kupują najnowsze procesory za dziesiątki tysięcy dolarów, naukowcy z Oksfordu pokazali coś zupełnie odwrotnego: dobrze zoptymalizowany kod potrafi tchnąć nowe życie w sprzęt, który większość osób dawno wywiozła na elektrośmieci. I zrobili to nie dla zabawy, lecz jako manifest, że AI wcale nie musi oznaczać drogich serwerowni i gigantycznego zużycia prądu.

Procesor Pentium II, 128 MB RAM i… językowy model AI

Za doświadczeniem stoi organizacja EXO Labs, założona przez badaczy związanych z Uniwersytetem Oksfordzkim. Zamiast budować laboratorium pełne kart graficznych, sięgnęli po komputer z końcówki lat 90.: procesor Pentium II 350 MHz i 128 MB pamięci RAM, pracujący pod kontrolą systemu Windows 98.

Na tej konfiguracji uruchomili niewielki model językowy, oparty na projekcie LLama2.c. To rodzaj lekkiej wersji dużego modelu językowego – wciąż potrafi generować teksty, ale ma znacznie mniej parametrów niż popularne rozwiązania w chmurze.

Model wykorzystany w eksperymencie miał 260 tysięcy parametrów i osiągnął prędkość około 39,3 tokena na sekundę na komputerze z 1998 roku – przy zaledwie 128 MB RAM.

Token to mały fragment tekstu – całe słowo albo jego część. Dla użytkownika liczy się to, że odpowiedź pojawia się na ekranie płynnie, a nie w tempie kilku znaków na minutę. Przy tak lekkim modelu stary pecet radzi sobie zaskakująco sprawnie.

Dlaczego mały model ma znaczenie

Twórcy porównali wyniki z tym, co stałoby się, gdyby spróbować uruchomić na takim sprzęcie większy model – na przykład o wielkości miliarda parametrów, wciąż mikroskopijny w porównaniu z GPT-4. Wtedy prędkość spadłaby do około 0,0093 tokena na sekundę. Innymi słowy, na jedną rozsądną odpowiedź trzeba by czekać całe wieki.

Eksperyment dobrze pokazuje, jak ogromne znaczenie ma dopasowanie rozmiaru modelu do możliwości sprzętu. Lekkie modele:

- dzięki mniejszej liczbie parametrów zużywają o wiele mniej pamięci RAM,

Podsumowanie

Badacze z EXO Labs z powodzeniem uruchomili lekki model językowy na komputerze z 1998 roku wyposażonym w procesor Pentium II i 128 MB RAM. Eksperyment dowodzi, że dzięki optymalizacji kodu AI może działać na sprzęcie uznawanym za elektrośmieci, bez potrzeby korzystania z drogich serwerowni.