10 lat temu Hawking ostrzegł przed katastrofą. Dziś jego słowa brzmią jak raport z 2026

Dziesięć lat temu Stephen Hawking snuł czarny scenariusz dla ludzkości.

Najważniejsze informacje:

- Stephen Hawking uważał kolonizację innych planet za niezbędną polisę ubezpieczeniową dla przetrwania gatunku

- Sztuczna inteligencja może stać się największym, ale i ostatnim wydarzeniem w historii cywilizacji

- W styczniu 2026 roku Zegar Zagłady wskazał rekordowe 85 sekund do północy

- Średnia temperatura Ziemi w grudniu 2025 wzrosła o 1,41 stopnia Celsjusza względem ery przedprzemysłowej

- W 2026 roku trwa intensywna rywalizacja USA, Chin i Rosji o bazy na Księżycu i zasoby orbitalne

W 2026 roku wiele elementów tej wizji zaczyna wyglądać zaskakująco realnie.

Astrofizyk ostrzegał, że jeśli człowiek nie opuści Ziemi i nie zacznie żyć na innych planetach, nasz gatunek może wyginąć w ciągu kilku tysięcy lat. Nie chodziło mu o nagły koniec jutro rano, ale o rosnące ryzyko katastrofy, które z roku na rok niebezpiecznie się kumuluje. Dzisiaj, przy rekordowo napiętej „Zegarze Zagłady”, jego słowa wracają z nową siłą.

Proroctwo sprzed dekady: odważne, ale chłodno policzone

W 2016 roku Hawking wystąpił na Uniwersytecie Oksfordzkim i nie owijał w bawełnę. Stwierdził, że prawdopodobieństwo globalnej katastrofy w jednej konkretnej dacie jest małe, lecz na przestrzeni tysięcy lat staje się niemal pewne. Według niego ludzkość gra w rosyjską ruletkę z własną planetą.

Z tej kalkulacji wysnuł mocną tezę: jeśli chcemy, by człowiek istniał za tysiąc czy dziesięć tysięcy lat, powinniśmy stać się gatunkiem międzyplanetarnym. Kolonizacja innych ciał niebieskich miała być nie kosmiczną fanaberią, ale polisą ubezpieczeniową na przetrwanie.

Hawking traktował kosmos jak plan awaryjny, a nie jak romantyczną wycieczkę – ucieczkę przed kumulacją zagrożeń, które sami stworzyliśmy.

AI jako zagrożenie egzystencjalne, nie tylko technologiczna zabawka

Jednym z najpoważniejszych lęków Hawkinga była sztuczna inteligencja. Nie chodziło mu o chatboty w stylu „zadaj pytanie i dostaniesz odpowiedź”, ale o wizję systemów, które w pewnym momencie zaczną ulepszać same siebie bez kontroli człowieka.

Singularność – moment, w którym człowiek traci ster

W 2016 roku podczas inauguracji ośrodka badawczego poświęconego przyszłości inteligentnych systemów Hawking mówił o tak zwanej osobliwości technologicznej. To punkt, w którym rozwój AI przyspiesza lawinowo, a ludzie przestają panować nad tym, co stworzyli. Według niego pełna, „silna” sztuczna inteligencja może stać się największym wydarzeniem w historii cywilizacji – ale równie dobrze ostatnim.

Dziś, gdy gigantyczne modele językowe, narzędzia generujące obrazy i film oraz autonomiczne systemy bojowe rozwijają się w tempie nieznanym z innych branż, ta przestroga nabiera zupełnie innej ostrości. Rywalizacja mocarstw o przewagę w AI często odbywa się kosztem refleksji nad etyką, bezpieczeństwem i zużyciem energii.

- państwa inwestują miliardy w wyścig technologiczny;

- trwa dyskusja, czy AI powinna decydować o użyciu broni;

- algorytmy wchodzą do bankowości, medycyny, sądów i armii;

- przepisy i kontrola społeczna nie nadążają za zmianami.

Do tego dochodzi jeszcze paradoks energetyczny: im potężniejsze modele, tym więcej prądu pochłaniają centra danych. W efekcie narzędzie, które ma pomagać w walce z kryzysem klimatycznym, samo ten kryzys podkręca.

Klimat, atom i broń biologiczna: zestaw ryzyk, który nie daje spać

Hawking wskazywał też na inne zagrożenia cywilizacyjne, które według niego zbliżają nas do „punktu bez powrotu”. Na pierwszym miejscu stawiał globalne ocieplenie. Uważał, że Ziemia może wejść w fazę zmian tak gwałtownych, że zatrzymanie ich stanie się fizycznie niemożliwe.

W grudniu 2025 roku średnia temperatura na Ziemi była już o 1,41 stopnia Celsjusza wyższa od poziomu sprzed rewolucji przemysłowej. Prognozy mówią, że granica 1,5 stopnia może zostać przekroczona w okolicach marca 2029. To próg, po którym rośnie ryzyko ekstremalnych zjawisk pogodowych, migracji klimatycznych i strat gospodarczych na skalę, której nie umiemy objąć wyobraźnią.

Do tego dochodzi stary, ale wciąż realny strach przed bronią atomową. Hawking przypominał, że instynkt agresji, który człowiek odziedziczył po przodkach, w połączeniu z technologią jądrową i biologiczną tworzy wybuchową mieszankę. W jego ocenie albo nauczymy się trzymać te impulsy na smyczy, albo pewnego dnia one pociągną za spust.

Zestaw: rozchwiany klimat, głowice jądrowe i zaawansowana AI – w oczach Hawkinga wyglądał jak przepis na kryzys, który prędzej czy później wymknie się spod kontroli.

Zegar Zagłady bije coraz głośniej

Jak te obawy wyglądają w roku 2026? Symboliczną odpowiedź daje słynny Zegar Zagłady, ustawiany przez grupę naukowców związanych niegdyś z Albertem Einsteinem i Robertem Oppenheimerem. W styczniu 2026 wskazówka zatrzymała się na 85 sekundach przed północą – to najbliżej punktu „katastrofy” od stworzenia tego symbolu po II wojnie światowej.

Ten zegar to nie prognoza wróżbity, ale uproszczony komunikat dla opinii publicznej: napięcia geopolityczne, wygasające traktaty rozbrojeniowe, rosnąca temperatura Ziemi i wyścig zbrojeń w AI tworzą środowisko wyjątkowo podatne na kryzys. Ludzkość nie stoi jeszcze nad przepaścią, ale zbliża się do balustrady z wyraźnie przyspieszonym krokiem.

Kosmos jako wybawienie czy luksusowa ucieczka?

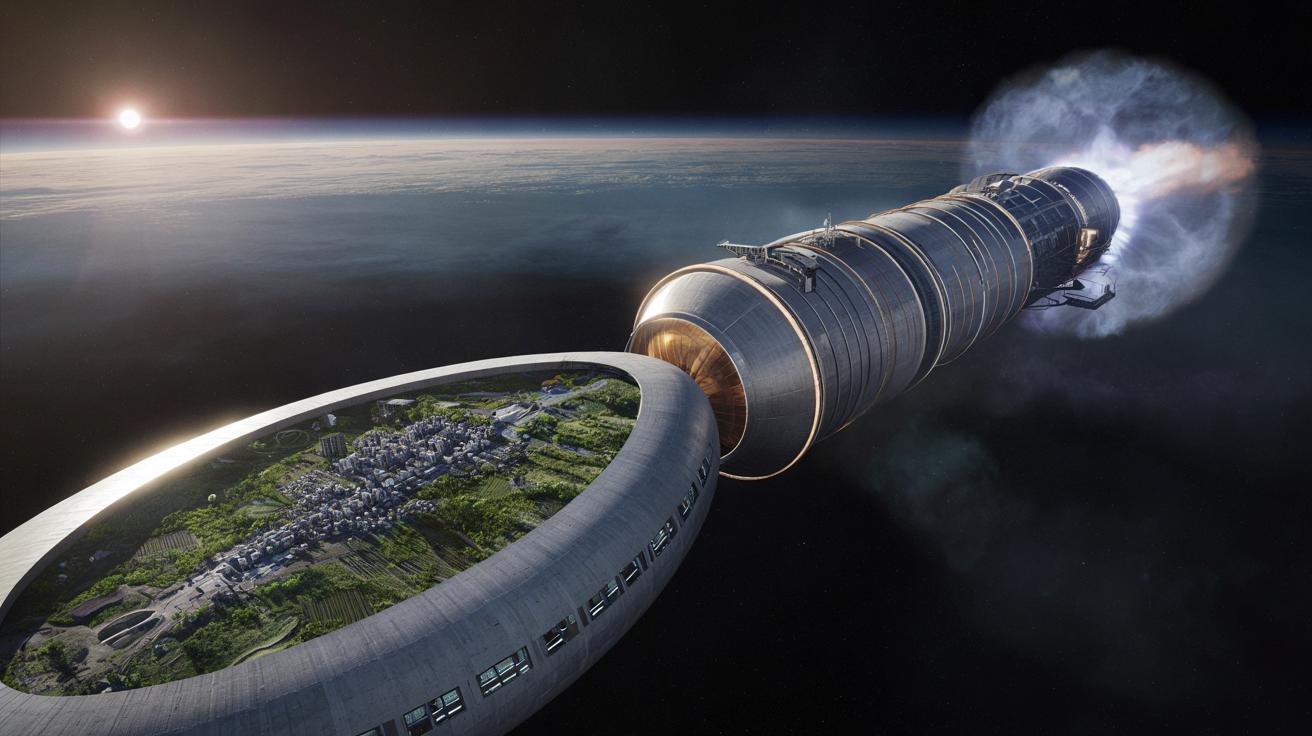

Wizja Hawkinga zakładała, że wyjściem z tej sytuacji będzie ekspansja w kosmos. W 2026 roku temat powraca w bardzo praktyczny sposób. Międzynarodowa Stacja Kosmiczna szykuje się do końca swojej misji, a równolegle rośnie gorączka związana z zasobami pozaziemskimi.

Nowy wyścig – tym razem o księżycowe złoża i orbitalne serwerownie

Waszyngton, Pekin i Moskwa planują bazy na Księżycu, sieci satelitów obsługujących komunikację i obserwację oraz ogromne centra danych na orbicie. W tle pojawiają się także projekty wojskowe – takie jak koncepcje tarcz antyrakietowych czy systemów kontrolujących przestrzeń kosmiczną, które mają chronić, ale jednocześnie podnoszą poziom nieufności między państwami.

Część ekspertów pyta więc wprost: czy ta „ucieczka w kosmos” nie odciąga uwagi od rozwiązań, które można jeszcze wdrożyć na Ziemi? Strategia kolonizacji innej planety nie pomoże, jeśli nie poradzimy sobie z konfliktami, brakiem zaufania i krótkowzrocznością polityczną. Te problemy zabierzemy ze sobą wszędzie – na Księżyc, Marsa, a nawet dalej.

Kosmos może być planem B, ale nikt rozsądny nie chciałby mieszkać na planecie awaryjnej, jeśli wciąż da się uratować tę, na której już żyje.

Między nadzieją a zegarem odliczającym czas

Mimo ponurej diagnozy Hawking nie należał do grona wiecznych pesymistów. Wierzył, że ludzkość ma zdolność uczenia się na błędach i potrafi przełamać własne ograniczenia. Liczył na rozwój nauki, lepsze rządzenie i zwykłą ludzką zaradność.

Rok 2026 pokazuje, że ostrzeżenia sprzed dekady nie były ani przesadzone, ani czysto teoretyczne. Z jednej strony widzimy gwałtowny rozwój technologii, rosnącą świadomość klimatyczną i pierwsze poważne próby uregulowania AI. Z drugiej – krótkoterminowe interesy polityczne i gospodarcze wciąż często wygrywają z myśleniem o tym, co stanie się za 50 czy 100 lat.

Co z tego wynika dla zwykłego człowieka?

Wydaje się, że ta dyskusja dotyczy wyłącznie rządów i koncernów technologicznych, ale w praktyce schodzi dużo niżej. Politycy reagują na nastroje wyborców, firmy na zachowania konsumentów. Im bardziej społeczeństwa domagają się odpowiedzialnych działań wobec klimatu, zbrojeń czy użycia AI, tym trudniej decydentom zupełnie je ignorować.

Dobrze też pamiętać, że ryzyka i korzyści splatają się ze sobą. Sztuczna inteligencja może pomóc w prognozowaniu klęsk żywiołowych i lepszym zarządzaniu energią, ale nieodpowiedzialnie wdrożona pogłębi nierówności i konflikty. Programy kosmiczne mogą przyspieszyć postęp naukowy i energetykę słoneczną, lecz jednocześnie uruchomić nowy wyścig zbrojeń ponad naszymi głowami.

Hawking miał rację w jednym: przyszłość nie jest z góry zapisana. Zegar Zagłady można przestawić w obie strony. Pytanie, czy wykorzystamy technologie, o które tak bardzo się martwił, do ograniczenia ryzyka, czy raczej przyspieszymy scenariusz rodem z kina science fiction, w którym to my stajemy się statystami we własnej historii.

Podsumowanie

Artykuł zestawia wizje Stephena Hawkinga sprzed dekady z rzeczywistością roku 2026, analizując zagrożenia związane z rozwojem AI i kryzysem klimatycznym. Tekst przygląda się również aktualnemu statusowi Zegara Zagłady oraz nowemu wyścigowi mocarstw o dominację w kosmosie.